Buscando soluciones al problema de la memoria de los LLM

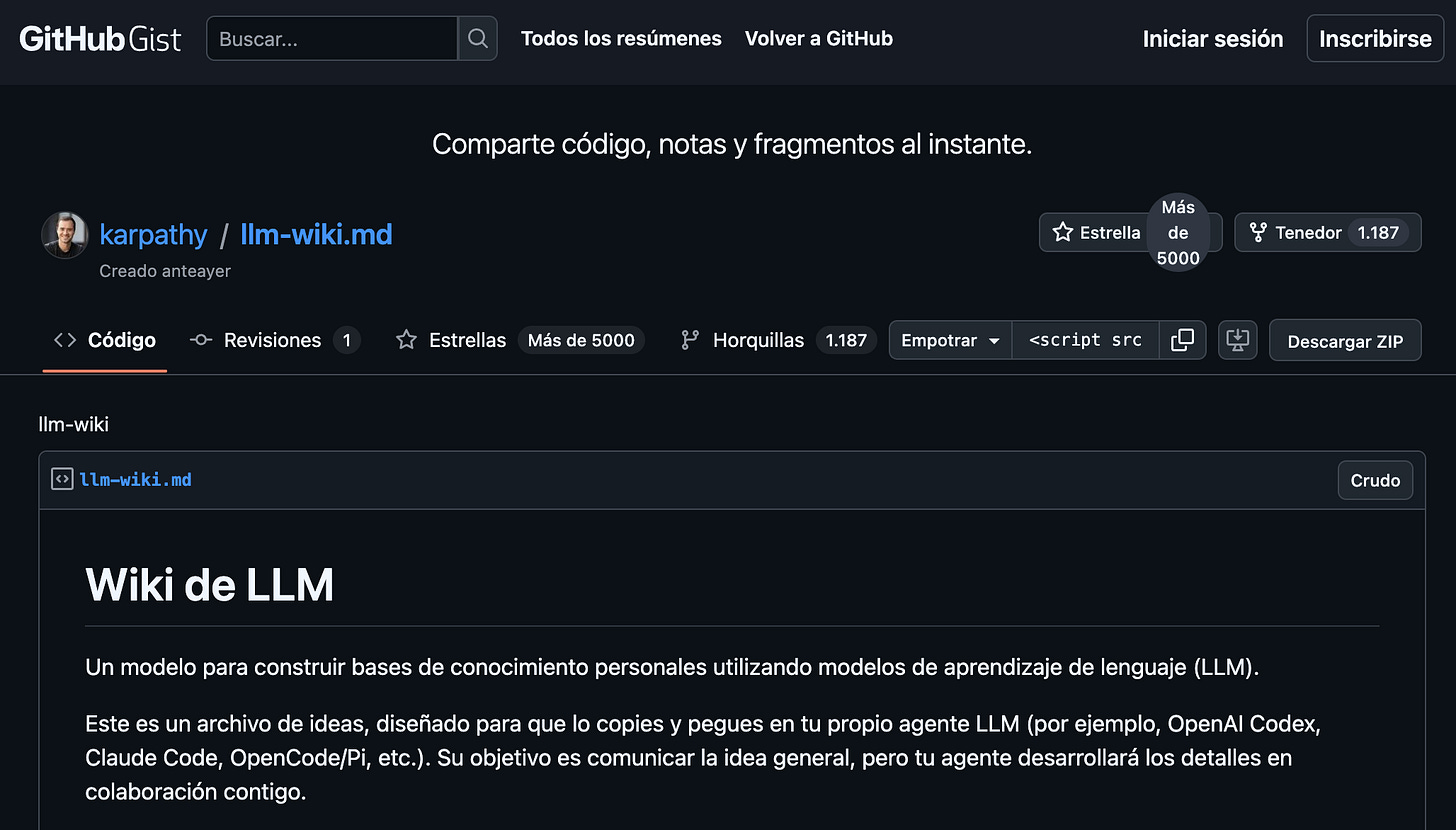

Karpathy lo ha vuelto a hacer. Tras inventarse el concepto de Vice Coding, nos ha regalado la idea de usar los wikis para mejorar el problema de la memoria de los asistentes de IA.

Desde la aparición de los Asistentes de IA basados en LLMs hemos ido encontrando diferentes técnicas para solucionar el problema de las alucinaciones negativas, las no deseadas.

Prompts: si le detallamos muy bien a la IA lo que tiene que hacer los resultados mejoran de manera significativa.

Contexto: cuánta más información tenga la IA sobre el ámbito en el que tiene que trabajar mejores resultados podrá ofrecernos.

Razonadores: ponemos a trabajar a varias IAs de manera coordinada para que propongan soluciones, las evalúen y las generen.

Ahora que estamos en pleno desarrollo de los Agentes de IA, se hace más necesario que nunca reducir las alucinaciones, no sea que le pidas que te compre un vuelo a París para tu luna de miel y acabes en un cohete camino de la Luna ;)

Y en esta búsqueda de soluciones al problema de las alucinaciones nos acabamos de topar con la idea de Andrej Karpathy, una de las personas que más ha contribuido al desarrollo de los Asistentes de IA cuando trabajaba en OpenAI.

Se trata de una ocurrencia para aprovechar el concepto de Wiki para solucionar el problema de la memoria de los LLM.

El problema de la memoria de los LLM se ha intentado resolver en los últimos años a través de las diferentes opciones de personalización, por ejemplo los GPTs y los proyectos permiten añadir archivos con información detallada de un tema y también se pueden añadir instrucciones personalizadas, como una especie de prompt permanente que la IA siempre debe tener en cuenta antes de responder.

Si usas NotebookML ya estás un poco más cerca de esta idea, porque ya sabes que le puedes dar un montón de contenido sobre el que trabajar y esto permite obtener resultados por parte de la IA que se adaptan mejor a tus necesidades.

Entonces lo que Karpathy, propone ahora es que usemos el formato Wiki para aportar a los Agentes de IA todo el contexto que necesita sobre nuestros proyectos y solucionar de esta forma el problema de la memoria, es decir que la IA necesita que le vayamos recordando las cosas todo el tiempo, a través de los prompts y el contexto.

La experiencia de la mayoría de las personas con los sistemas de gestión del conocimiento (LLM) y los documentos se asemeja a la de los sistemas RAG: se sube una colección de archivos, el LLM recupera los fragmentos relevantes al momento de la consulta y genera una respuesta. Esto funciona, pero el LLM redescubre el conocimiento desde cero para cada pregunta. No hay acumulación. Si se formula una pregunta sutil que requiere sintetizar cinco documentos, el LLM tiene que encontrar y unir los fragmentos relevantes cada vez. No se acumula nada. NotebookLM, la carga de archivos de ChatGPT y la mayoría de los sistemas RAG funcionan de esta manera.

La idea aquí es diferente. En lugar de simplemente recuperar información de documentos originales al momento de la consulta, LLM construye y mantiene de forma incremental una wiki persistente : una colección estructurada e interconectada de archivos Markdown que actúa como intermediario entre usted y las fuentes originales. Cuando agrega una nueva fuente, LLM no solo la indexa para su posterior recuperación, sino que la lee, extrae la información clave y la integra en la wiki existente, actualizando las páginas de entidades, revisando los resúmenes de temas, señalando dónde los nuevos datos contradicen afirmaciones anteriores y reforzando o cuestionando la síntesis en evolución. El conocimiento se compila una sola vez y se mantiene actualizado , en lugar de ser derivado nuevamente con cada consulta.

Cómo llevar a la práctica esta idea

Para poner en práctica la idea de Karpathy necesitas usar Claude Code o ChatGPT Codex, este es un pequeño obstáculo económico y técnico, pero vale la pena superarlo.

Cada vez quedan menos excusas para no pagar por estas IAs y usar las herramientas más avanzadas.

Así que manos a la obra

Dale a Code o Codex este texto, tal cual.

Elige un tema en el que vayas a trabajar.

Sigue las instrucciones que la propia IA te vaya dando.

Y a disfrutar del proceso.

Sí ya sé, lo que a ti te gustaría es tenerlo todo integrado en ChatGPT, Claude o Gemini, sin tener que instalarte nada o usar otras herramientas, pero paciencia, todo llegará. Hasta entonces bien vale el esfuerzo de enfrentarse a lo desconocido.